제품문의

제품과 관련하여 궁금하신 사항을

문의하기를 통해 해결하세요.

AI and Data Science

Data Center &

Cloud Computing

Design and

Visualization

Robotics &

Edge Computing

HPC-Performance

Computing

Self-Driving Vehicles

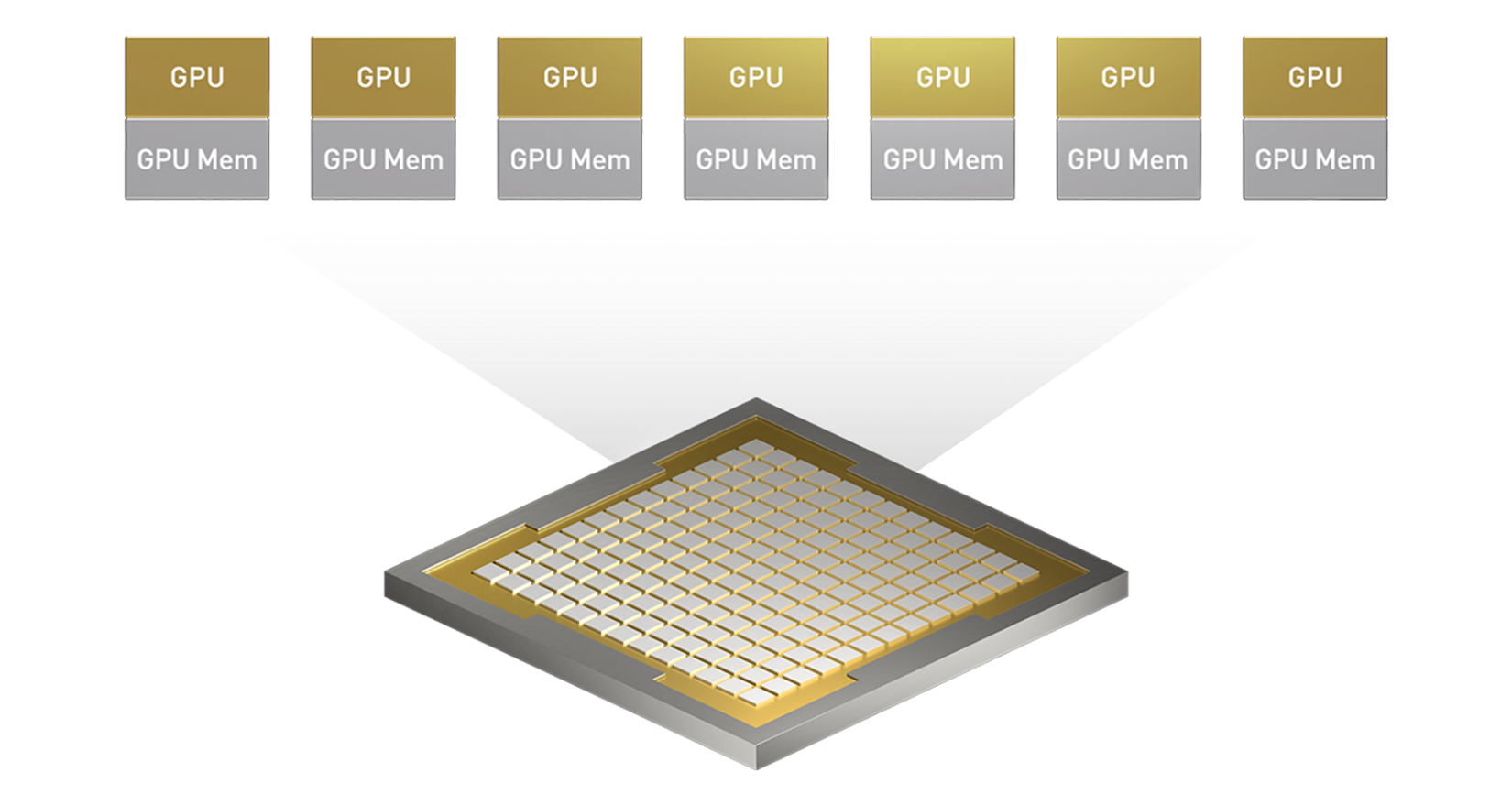

Hopper Architecture

8x NVIDIA H100 Tensor Core GPUs

Performance : 32 petaFLOPS FP8

GPU Memory 640GB Total

System Memory 2 TB

CPU : Dual x86

OS: 2x 1.9TB NVMe M.2

Internal storage: 8x 3.84TB NVMe U.2

NVIDIA® NVSwitch™ x4

DGX H100은 세계 최초 특수 목적 AI 인프라의 4세대로서 새로운 NVIDIA AI 소프트웨어 솔루션 제품군 지원, 풍부한 서드파티 지원 에코시스템, NVIDIA 전문 서비스에서 제공하는 전문가 자문이 포함된 고도로 최적화된 하드웨어와 소프트웨어 플랫폼을 제공합니다.

NVIDIA DGX H100은 NVIDIA DGX SuperPOD를 위한 6배 더 빠른 성능, 2배 더 빠른 네트워킹, 고속 확장성을 지원합니다. 차세대 아키텍처는 자연어 처리 및 딥 러닝 추천 모델과 같은 초대규모 워크로드에서 그 강력함을 드러냅니다.

NVIDIA H100 Tensor Core GPU를 탑재해 AI 규모와 성능의 한계를 뛰어넘는 DGX H100은 NVIDIA ConnectX®-7 스마트 네트워크 인터페이스 카드(Smart NIC) 및 NVIDIA BlueField®-3 데이터 처리 장치(DPU)로 6배 향상된 성능, 2배 빠른 네트워킹과 NVIDIA DGX SuperPOD를 위한 고속 확장성을 제공합니다.

DGX H100은 직접 관리할 수 있는 온프레미스 설치는 물론, NVIDIA DGX 지원 데이터센터에 공동 배치, NVIDIA DGX Foundry에 임대 및 NVIDIA 인증 관리형 서비스 공급업체를 통한 접근도 가능합니다. 또한 조직은 DGX 지원 라이프사이클 관리를 통해 최첨단 배포를 유지할 수 있는 예측 가능한 금융 모델을 확보할 수 있습니다.

딥 러닝 워크스테이션 솔루션을 통해 작업 공간에서 편리하게 AI 슈퍼 컴퓨팅 성능을 활용하고 NGC에서 필요한 모든 딥 러닝 소프트웨어를 사용할 수 있습니다. 이제 딥 러닝을 필요로 하는 누구든지 데스크 사이드 딥 러닝을 시작할 수 있습니다.

모든 엔터프라이즈에서 물리적 데이터센터를 구축할 필요 없이 손쉽게 대규모 컴퓨팅 성능에 액세스할 수 있습니다. AI, 고성능 컴퓨팅(HPC) 및 의료 영상 활용, 차세대 그래픽 기술 적용 등 워크로드 전반에서 최고 성능을 경험할 수 있습니다.

GPU 가속 데이터센터는 원하는 규모와 더 적은 수의 서버로 컴퓨팅 및 그래픽 워크로드에 혁신적인 성능을 제공하여 더 빠르게 정보를 얻고 비용을 획기적으로 절감할 수 있습니다. 가장 복잡한 딥 러닝 모델을 트레이닝하여 가장 심각한 문제를 해결하세요.

현대 기업은 이제 수 십억 개의 IoT 센서를 통해 생성 된 데이터를 활용해 더 빠른 통찰력과 시간과 비용 절감을 할 수 있습니다. 실시간으로 결정을 내리고 강력하고 분산 된 컴퓨팅과 안전하고 간단한 원격 관리 및 업계 최고 기술과의 호환성을 기대할 수 있습니다.

NVIDIA Hopper™ 아키텍처는 새로운 8비트 부동 소수점 정밀도(FP8)를 사용하는 Transformer Engine으로 4세대 Tensor 코어를 발전시켜 1조 매개변수 모델 교육을 위해 FP16보다 6배 더 높은 성능을 제공합니다. TF32, FP64, FP16 및 INT8 정밀도를 사용하여 3배 향상된 성능과 결합된 Hopper Tensor Core는 모든 워크로드에 최고의 속도 향상을 제공합니다.

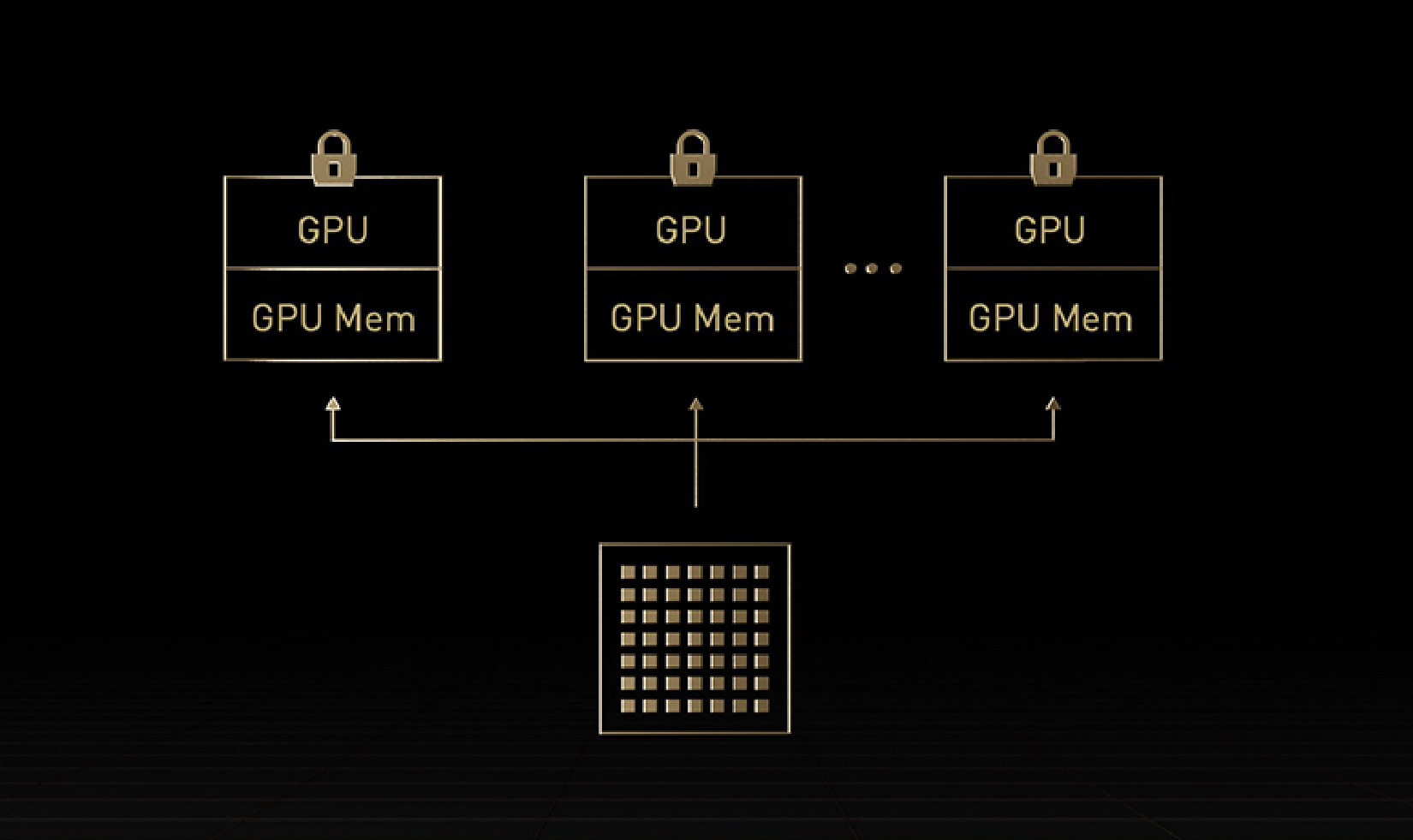

강력한 하드웨어 기반 보안을 통해 사용자는 온프레미스, 클라우드 또는 에지에서 애플리케이션을 실행할 수 있으며 승인되지 않은 엔터티가 사용 중인 애플리케이션 코드 및 데이터를 보거나 수정할 수 없다는 확신을 가질 수 있습니다. 이를 통해 데이터 및 애플리케이션의 기밀성과 무결성을 보호하는 동시에 AI 교육, AI 추론 및 HPC 워크로드를 위한 H100 GPU의 전례 없는 가속화에 액세스합니다.

컴퓨팅 집약적 워크로드에 대해 더 높은 대역폭과 감소된 지연 시간을 제공합니다. 고속 공동 작업을 가능하게 하기 위해 각 NVSwitch에는 네트워크 내 감소 및 멀티 캐스트 가속을 위한 NVIDIA SHARP™ 용 엔진이 장착된 64개의 NVLink 포트가 있습니다.

단일 서버에서 더 많은 GPU를 지원하며 GPU 사이에 완전한 대역폭 연결성을 보장하는 GPU 패브릭으로 딥 러닝 성능을 다음 단계로 끌어올립니다. 각 GPU의 NVLink 12개가 NVSwitch로 완전히 연결되어 올투올(All-to-all) 고속 통신을 지원합니다.

Hopper 아키텍처는 최대 7개의 GPU 인스턴스에 걸쳐 가상화된 환경에서 다중 테넌트, 다중 사용자 구성을 지원하여 MIG를 더욱 강화하고 하드웨어 및 하이퍼바이저 수준에서 기밀 컴퓨팅으로 각 인스턴스를 안전하게 격리합니다. 각 MIG 인스턴스에 대한 전용 비디오 디코더는 공유 인프라에서 안전한 고처리량 IVA를 제공합니다. 또한 동시 MIG 프로파일링을 통해 관리자는 적절한 크기의 GPU 가속을 모니터링하고 사용자를 위한 최적화된 리소스 할당이 가능합니다.

동적 프로그래밍은 복잡한 재귀 문제를 더 간단한 하위 문제로 분해하여 해결하는 알고리즘 기술로 나중에 다시 계산할 필요가 없도록 하위 문제의 결과를 저장함으로써 기하급수적인 문제 해결의 시간과 복잡성을 줄입니다. Hopper 아키텍처는 동적 프로그래밍 알고리즘을 CPU에 비해 40배, Ampere 아키텍처 GPU에 비해 7배 가속화하는 DPX 명령을 도입했습니다. 이를 통해 질병 진단, 실시간 라우팅 최적화 및 그래프 분석 시간을 획기적으로 단축할 수 있습니다.

데이터 센터 없이 실험과 개발을 위한 서버 급의 성능을 제공하는 이상적인 plug-and-go AI 시스템

다양한 서버 솔루션을 통한 가장 복잡한 AI 과제를 처리가 가능한 슈퍼컴퓨터의 핵심 구성 요소

스토리지, 컴퓨팅, 네트워킹 분야의 업계 리더와 함께 구축한 업계 표준 AI 인프라 디자인

대규모 AI Enterprise를 위한 가장 빠른 길을 제공하는 업계 최고의 Full-cycle 인프라

딥 러닝 신경망이 더욱 복잡 해짐에 따라 훈련 시간이 크게 증가하여 생산성이 낮아지고 비용이 높아집니다. NVIDIA의 딥 러닝 기술과 완전한 솔루션 스택은 AI 교육을 크게 가속화하여 더 짧은 시간에 더 깊은 통찰력을 얻고 상당한 비용을 절감하며 ROI 달성 시간을 단축합니다.

이제 컴퓨터는 스스로 학습하고 생각할 수 있는 단계 까지 왔습니다. 이로 인해 로봇, 의료, 자율 주행 차량 분야 등에서 혁신적인 기회가 생겨나고 있습니다. 딥 러닝 애플리케이션을 설계하고 개발하면 이러한 놀라운 기회를 직접 만나보실 수 있습니다.

NVIDIA Tensor 코어 GPU의 성능을 얻기 위한 핵심인 고성능 인퍼런스 플랫폼은 CPU로만 구성된 플랫폼과 비교해 최대 40배 높은 처리량을 제공하는 동시에 지연 시간을 최소화합니다. TensorRT를 사용하면 모든 프레임워크에서 시작하여 트레이닝한 신경망을 생산에서 빠르게 최적화, 검증 및 배포할 수 있습니다.

GPU 가속 딥 러닝 프레임 워크는 사용자 지정 심층 신경망을 설계 및 훈련하는 유연성을 제공하고 Python 및 C/C ++와 같이 일반적으로 사용되는 프로그래밍 언어에 대한 인터페이스를 제공합니다. TensorFlow, PyTorch 등과 같은 모든 주요 딥 러닝 프레임 워크는 이미 GPU 가속화되어 있어 GPU 프로그래밍 없이 몇 분 만에 생산성을 높일 수 있습니다.

비즈니스는 머신 러닝을 사용하여 제품, 서비스 및 운영을 개선합니다. 대량의 과거 데이터를 활용하여 고객 행동을 예측하고 내부 프로세스를 개선하기 위한 모델을 구축할 수 있습니다. 머신 러닝은 엔터프라이즈에 놀라운 가치를 제공하지만 오늘날의 CPU 기반 방식은 복잡성과 오버헤드를 가중시켜 비즈니스의 투자 수익을 감소시킬 수 있습니다.

모델 반복으로 인한 오버헤드 추가, 다운 샘플링으로 모델의 정확도 감소 또는 모델 프로덕션화에 걸리는 시간 소모 등 최적화된 하드웨어와 소프트웨어를 결합하여 기존에 존재하던 머신 러닝의 복잡성과 비효율성이 사라지고 비즈니스에서 가속화된 머신 러닝의 성능을 활용 가능합니다.

고성능 처리 기능을 통해 테라바이트 단위의 데이터세트를 분석하여 더 정확한 결과를 도출하고 더 빠르게 보고할 수 있으며 모든 데이터를 활용하여 더 나은 비즈니스 의사 결정을 내리고, 조직의 성과를 개선하고, 고객의 요구를 더 잘 충족할 수 있습니다.

CPU 기반 업계 표준보다 19배 빠른 솔루션으로 프로세스가 끝날 때까지 기다리는 시간은 줄이고 솔루션 반복과 테스트에 더 많은 시간을 할애할 수 있으며 CPU 기반 업계 표준보다 7배 비용 효율적인 솔루션을 갖춘 GPU 가속화로 예산을 최대한 활용할 수 있습니다.

데이터 사이언티스트의 생산성을 증대하고 부가 가치가 없는 ROI를 줄일 수 있습니다. 컨셉에서 프로덕션까지 제품 개발 사이클을 가속화하고 DGX 전문가와 함께 문제점을 해결하세요.

모든 AI 워크로드를 위한 하나의 시스템으로 간소화된 인프라 디자인과 용량 계획을 경험할 수 있습니다. 최고의 컴퓨팅 밀도 및 성능을 최소한의 공간에서 달성하세요. 컨테이너부터 칩까지 층마다 내장된 보안을 활용할 수 있습니다.

즉시 실행할 수 있는 최적화된 AI 소프트웨어로 지루한 설정 및 테스트가 필요하지 않으며 전례없는 성능으로 더 빠른 반복 작업이 가능한 더 나은 모델을 더 일찍 확인할 수 있습니다. 또한 시스템 통합과 소프트웨어 엔지니어링에 소비되는 시간을 줄일 수 있습니다.

데이터 사이언스와 AI를 발전시키려면 조직은 클라우드 및 데이터센터에서 엣지에 이르는

GPU 기반 시스템을 최적화할 수 있는 도구를 이용해야 합니다.

NVIDIA의 소프트웨어 솔루션은 모든 최신 워크로드를 포괄하므로 IT 관리자, 데이터 사이언티스트,

DevOps 팀과 개발자가 필요한 것을 빠르고 쉽게 이용할 수 있습니다.

End-to-End 워크플로우 단순화 및 가속 GPU 최적화 AI, 고성능 컴퓨팅(HPC), 데이터 분석 소프트웨어의 허브입니다. 온프레미스, 클라우드 또는 엣지에 배포될 수 있는 엔터프라이즈급 컨테이너, 사전 트레이닝된 AI 모델, 산업별 SDK를 통해 엔터프라이즈는 동급 최고의 솔루션을 구축하고 그 어느 때보다 빨리 비즈니스 가치를 제공할 수 있습니다.

CUDA-X AI는 딥 러닝, 머신 러닝 및 HPC(고성능 컴퓨팅)를 위한 필수 최적화를 제공하는 NVIDIA의 획기적인 병렬 프로그래밍 모델인 CUDA® 위에 구축된 소프트웨어 가속화 라이브러리 컬렉션입니다. cuDNN, cuML, NVIDIA® TensorRT™, cuDF, cuGraph 및 13개 이상의 기타 라이브러리가 포함됩니다.

NVIDIA Magnum IO™는 병렬의 비동기식 지능형 데이터센터 IO를 위한 아키텍처로, 멀티 GPU, 멀티 노드 가속화를 위해 스토리지 및 네트워크 IO 성능을 극대화합니다. 스토리지 IO, 네트워크 IO, 인-네트워크 컴퓨팅 및 IO 관리를 활용하여 멀티 GPU, 멀티 노드 시스템을 위한 데이터 이동, 액세스 및 관리를 단순화하고 가속화합니다.

자체적 배포와 관리의 어려움 없이도 우수한 AI 개발을 원하는 비즈니스를 위한 세계 최상급 인프라 솔루션은 NVIDIA DGX SuperPOD™ 아키텍처를 기반으로 하고 있으며, 월별 구독으로 이용 가능합니다. DGX 시스템 및 스토리지 전반에 걸쳐 워크로드를 오케스트레이션하기 위한 NVIDIA Base Command™ 액세스합니다.

NVIDIA Base Command™는 기업과 데이터 과학자가 AI 개발을 가속화할 수 있도록 지원하는 엔터프라이즈급 AI 훈련 소프트웨어 서비스입니다. Base Command는 AI 훈련 프로젝트를 중앙 집중식으로 제어하며, NVIDIA DGX™ Foundry 를 비롯한 다양한 NVIDIA 가속 인프라 옵션과 함께 작동합니다.

엣지, 데이터센터 및 멀티/하이브리드 클라우드 환경에서 이종 HPC 및 AI 서버 클러스터를 위한 신속한 배포 및 엔드 투 엔드 관리를 제공합니다. 몇 개의 노드에서 수십만 개에 이르는 클러스터까지 프로비저닝 및 관리를 자동화하고 CPU 기반 및 NVIDIA GPU 가속 시스템을 지원하며 Kubernetes를 통한 오케스트레이션을 지원합니다.

모든 조직에서 AI를 사용할 수 있도록 최적화된 엔드 투 엔드 클라우드 기반 AI 및 데이터 분석 소프트웨어 제품군입니다. 엔터프라이즈 데이터센터에서 퍼블릭 클라우드에 이르기까지 어디에서나 배포할 수 있도록 인증 받았고, AI 프로젝트를 순조롭게 진행하기 위한 글로벌 엔터프라이즈 지원이 포함됩니다.

H100은 완전한 NVIDIA 데이터센터 솔루션의 일부로, 다양한 하드웨어, 네트워킹, 소프트웨어, 라이브러리 및 NGC™의 최적화된 AI 모델과 애플리케이션에 걸쳐 빌딩 블록을 통합합니다. 연구원은 데이터센터를 위한 가장 강력한 엔드 투 엔드 AI 및 HPC 플랫폼을 통해 실제 결과를 빠르게 제공하고 솔루션을 규모에 맞게 프로덕션에 배포할 수 있습니다.

또한 NVIDIA AI Enterprise 소프트웨어를 사용하면 NVIDIA-Certified Systems를 통해 VMware vSphere에서 실행되도록 NVIDIA가 최적화, 인증, 지원하는 AI 및 데이터 분석 소프트웨어의 엔드 투 엔드 클라우드 네이티브 제품군에 액세스할 수 있습니다. NVIDIA AI Enterprise에는 최신 하이브리드 클라우드에서 AI 워크로드의 빠른 배포, 관리 및 확장을 지원하는 NVIDIA의 주요 기반 기술이 포함되어 있습니다.

MIG 없이 동일한 GPU에서 서로 다른 AI 추론 요청 등의 다양한 작업을 실행하면 각 작업이 동일한 리소스를 두고 경쟁합니다. 더 큰 메모리 대역폭을 소비하는 작업이 다른 작업을 방해하여 일부 작업은 지연 시간 목표를 달성하지 못하는 결과가 발생합니다. MIG를 사용하면 컴퓨팅, 메모리, 메모리 대역폭을 위한 전용 리소스를 갖춘 서로 다른 인스턴스에서 작업이 동시에 실행되므로 서비스 품질을 통한 예측 가능한 성능과 GPU 사용률을 극대화할 수 있습니다.

컴퓨팅, 메모리, 캐시를 위한 전용 하드웨어 리소스 세트를 통해 각 MIG 인스턴스는 보장된 서비스 품질 및 결함 격리를 제공합니다. 따라서 하나의 인스턴스에서 실행되는 애플리케이션에 오류가 발생해도 다른 인스턴스에서 실행되는 애플리케이션에 영향을 주지 않습니다.

이는 또한 서로 다른 인스턴스에서 대화식 모델 개발, 딥 러닝 트레이닝, AI 추론, HPC 애플리케이션과 같은 서로 다른 유형의 워크로드를 실행할 수 있음을 의미합니다. 인스턴스가 병렬로 실행되므로 워크로드 역시 병렬로 실행되지만, 동일한 물리적 GPU에서 분리되고 격리됩니다.

7x 10GB / 4x 20GB

2x 40GB (더 큰 컴퓨팅 용량) / 1x 80GB

동시에 모든 인스턴스에서 가능

7x

인스턴스 당 전용 NVJPEG 및 NVDEC

Yes

예비 사양은 변경될 수 있습니다.

NVIDIA Hopper™ 아키텍처 덕분에 H100은 최대 7개의 GPU 인스턴스에 걸쳐 가상화된 환경에서 멀티 테넌트 및 멀티 사용자 구성을 지원하여 MIG를 더욱 향상하고, 하드웨어 및 하이퍼바이저 수준에서 기밀 컴퓨팅으로 각 인스턴스를 안전하게 격리합니다. 각 MIG 인스턴스에 대한 전용 비디오 디코더는 공유 인프라에서 안전하고 처리량이 높은 지능형 영상 분석(IVA)을 제공합니다. 관리자는 Hopper의 동시 MIG 프로파일링을 통해 적합한 크기의 GPU 가속을 모니터링하고 여러 사용자를 위한 리소스를 할당할 수 있습니다.

워크로드가 적은 연구원의 경우 전체 클라우드 인스턴스를 대여하기보다는 MIG를 사용하여 GPU의 일부를 안전하게 격리하는 동시에 데이터를 저장, 전송, 사용 시 안전하게 보호할 수 있습니다. 이를 통해 클라우드 서비스 제공업체가 가격을 책정하고 더 작은 고객 기회를 해결할 때의 유연성을 개선할 수 있습니다.

NVIDIA AI 스타터 키트는 세계적인 수준의 AI 플랫폼에서 부터 최적화된 소프트웨어 및 도구를 거쳐 컨설팅 서비스에 이르는 모든 것을 팀에게 제공함으로 AI 이니셔티브를 빠르게 시작할 수 있습니다. AI 플랫폼을 구축에 시간과 비용을 최소화 하세요. 하루 안에 설치 및 가동하고, 일주일 안에 사용 사례를 정의하고, 보다 빠르게 모델을 상용화할 수 있습니다.

| GPU | 8x NVIDIA H100 Tensor Core GPUs |

|---|---|

| GPU Memory | 640GB total |

| Performance | 32 petaFLOPS FP8 |

| NVIDIA NVSwitches | 4x |

| System Power Usage | ~10.2kW max |

| CPU | Dual x86 |

| System Memory | 2TB |

| Networking |

|

| Management network |

10Gb/s onboard NIC with RJ45 50Gb/s Ethernet optional NIC Host baseboard |

| Storage |

|

| Software |

|

| Operating Temperature Range | 5-30 ºC (41-86 ºF) |

| 상품명 | NVIDIA DGX H100 640GB 엔비디아 코리아 정품 |

|---|---|

| KC 인증번호 | - |

| 정격전압 / 최대소비전력 | ~10.2kW max |

| 정품 품질 보증 | 3년 무상보증 |

| 출시년월 | 2022/07 |

| 제조사 | NVIDIA Corporation |

| 제조국 | 중국 |

| 크기 | - |