NVIDIA Grace CPU Superchip 엔비디아코리아 정품

- 144 Arm Neoverse V2 cores with 4x128b SVE2

- 240GB, 480GB, and 960GB on-module memory options

- Up to 768 GB/s for 960GB

- Up to 1024 GB/s for 240GB, 480GB

- 900GB/s NVLink®-C2C

- Up to 8x PCIe Gen5 x16 option to bifurcate

- Up to 500W TDP with memory (CPU + memory)

리더스시스템즈에서 제공하는 데이터 센터를 위한 맞춤형 솔루션

-

워크스테이션 딥 러닝 솔루션

딥 러닝 워크스테이션 솔루션을 통해 작업 공간에서 편리하게 AI 슈퍼 컴퓨팅 성능을 활용하고 NGC에서 필요한 모든 딥 러닝 소프트웨어를 사용할 수 있습니다. 이제 딥 러닝을 필요로 하는 누구든지 데스크 사이드 딥 러닝을 시작할 수 있습니다.

-

GPU 클라우드 컴퓨팅 솔루션

모든 엔터프라이즈에서 물리적 데이터센터를 구축할 필요 없이 손쉽게 대규모 컴퓨팅 성능에 액세스할 수 있습니다. AI, 고성능 컴퓨팅(HPC) 및 의료 영상 활용, 차세대 그래픽 기술 적용 등 워크로드 전반에서 최고 성능을 경험할 수 있습니다.

-

온 프레미스 가속 컴퓨팅 솔루션

GPU 가속 데이터센터는 원하는 규모와 더 적은 수의 서버로 컴퓨팅 및 그래픽 워크로드에 혁신적인 성능을 제공하여 더 빠르게 정보를 얻고 비용을 획기적으로 절감할 수 있습니다. 가장 복잡한 딥 러닝 모델을 트레이닝하여 가장 심각한 문제를 해결하세요.

-

엣지 컴퓨팅 솔루션

현대 기업은 이제 수 십억 개의 IoT 센서를 통해 생성 된 데이터를 활용해 더 빠른 통찰력과 시간과 비용 절감을 할 수 있습니다. 실시간으로 결정을 내리고 강력하고 분산 된 컴퓨팅과 안전하고 간단한 원격 관리 및 업계 최고 기술과의 호환성을 기대할 수 있습니다.

오늘날 AI 데이터 센터의 성능 및 효율성 요구 사항을 충족하도록 설계되었습니다.

NVIDIA Grace™ CPU는 새로운 유형의 데이터 센터를 위해 설계되었습니다. 엄청난 양의 데이터를 처리하여 최대 에너지 효율로 지능을 생성하는 데이터센터 입니다. 이러한 데이터센터는 AI, 데이터 분석, 하이퍼스케일 클라우드 애플리케이션, 고성능 컴퓨팅(HPC) 등 다양한 워크로드를 실행합니다. 가장 까다로운 데이터 센터 요구 사항을 충족하기 위해 Grace는 현재 업계 최고 수준의 서버 대비 2배 높은 와트당 성능, 2배 높은 패키징 밀도, 그리고 가장 높은 메모리 대역폭을 제공합니다. Grace CPU는 72개의 고성능 및 전력 효율적인 Arm® Neoverse™ V2 코어를 NVIDIA Scalable Coherency Fabric(SCF)과 연결하여 기존 CPU의 두 배에 달하는 3.2TB/s의 양분 대역폭을 제공하여 Arm 생태계와의 완벽한 호환성을 유지하면서도 최고의 성능을 제공합니다. Grace는 서버급 고속 LPDDR5X 메모리와 광범위한 메모리 서브시스템을 활용하는 최초의 데이터센터 CPU로, 기존 DDR 메모리의 5분의 1에 불과한 성능으로 최대 500GB/s의 대역폭을 제공하며, 비용은 비슷합니다.

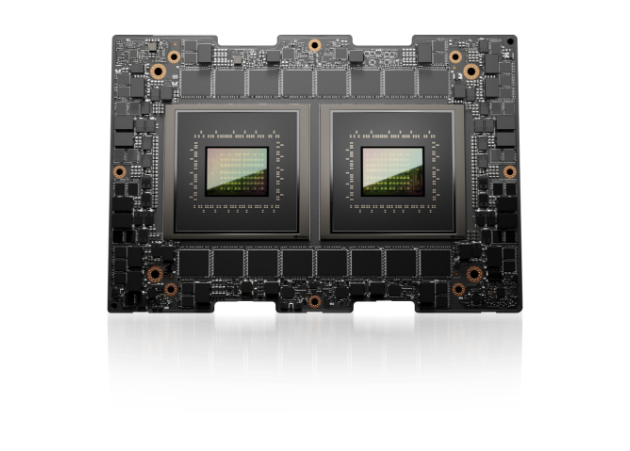

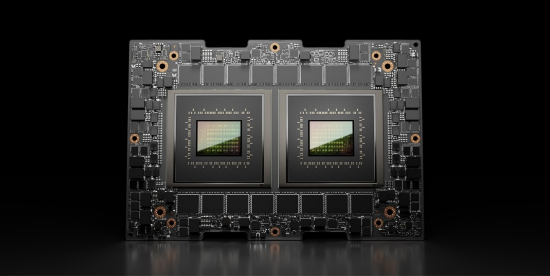

NVIDIA Grace CPU Superchip

Grace CPU Superchip은 NVIDIA NVLink™ Chip-to-Chip(C2C)을 통해 900GB/s의 속도로 연결된 두 개의 Grace CPU 칩으로 구성됩니다. 144개의 Neoverse V2 코어를 단일 모듈에 탑재하고 있으며, 최대 1TB/s의 메모리 대역폭을 제공하는 서버급 LPDDR5X 메모리를 탑재했습니다. Grace CPU Superchip은 컴팩트한 모듈 형태로 2소켓 서버의 핵심을 이루며, DDR5 메모리를 탑재한 기존 서버 CPU보다 동일한 전력으로 2배 높은 성능을 제공합니다.

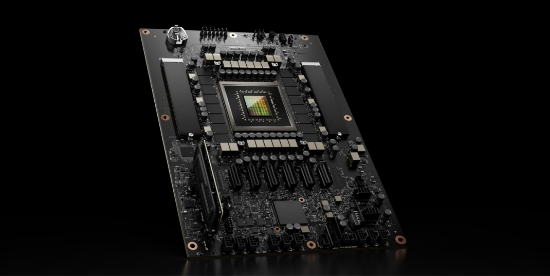

NVIDIA Grace CPU C1

NVIDIA Grace C1은 하이퍼스케일 클라우드, CDN, 스토리지, 통신사 및 기타 고성능 엣지 플랫폼을 포함한 확장형 및 엣지 플랫폼에 최적화된 단일 소켓 고성능 서버 플랫폼으로, 성능이나 대역폭 저하 없이 운영됩니다. 이 플랫폼은 고성능 x86 성능을 제공하는 동시에 Grace CPU와 LPDDR5X 메모리의 전력 소비량을 140W에서 250W까지 조절할 수 있습니다. 이는 유사한 x86 플랫폼의 400W 이상과 비교되는 수치입니다. NVIDIA가 설계한 확장 가능한 일관성 패브릭 덕분에 Grace CPU는 주요 x86 플랫폼 대비 2배 높은 에너지 효율을 제공합니다.

NVIDIA Grace CPU, Arm 소프트웨어 생태계와 통합

데이터 센터의 전력 제약이 심화됨에 따라, 최대한 많은 워크로드를 가속화하고 나머지는 가장 효율적인 컴퓨팅으로 실행하는 것이 매우 중요합니다. Grace CPU는 가속화된 작업과 CPU 전용 작업을 모두 처리하도록 최적화되어 기존 CPU보다 동일한 전력으로 최대 2배의 성능을 제공합니다.

Grace CPU로 데이터 센터 출력을 두 배로 늘리거나 에너지 사용량을 절반으로 줄이세요

-

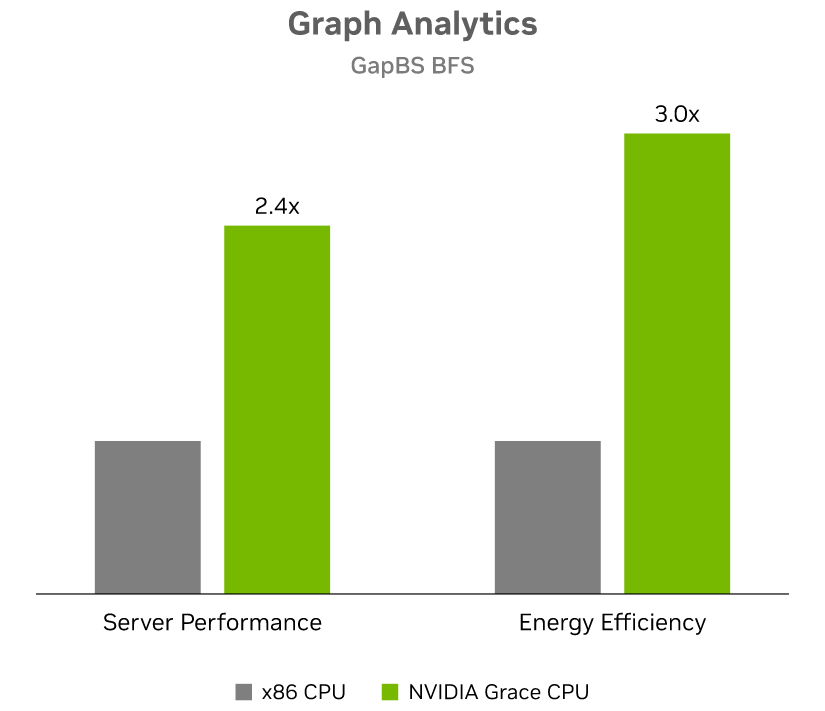

Graph Analytics

vs. x86 CPU -

Data Analytics

vs. x86 CPU -

Weather

vs. x86 CPU -

Microservices

vs. x86 CPU

NVIDIA Grace Superchip 480GB LPDDR5X, AMD EPYC 9654 768GB DDR5. OS: Ubuntu 22.04, 컴파일러: GCC 12.3 (아래에 별도로 명시되지 않는 한). 에너지 효율을 위한 전력 소비량은 CPU + 메모리 측정 전력을 포함합니다. 그래프 분석: 갭 벤치마크 스위트 BFS arXiv:1508.03619 [cs.DC], 2015. 데이터 분석: HiBench+K-means Spark(HiBench 7.1.1, Hadoop 3.3.3, Spark 3.3.0; Grace: NVHPC 24.5, x86: Intel 2021.4) 날씨: ICON QUBICC 80km 해상도 NVHPC 24.5(Grace) ICC 2021.4(x86) 마이크로서비스: Google Protobufs(커밋 7cd0b6fbf1643943560d8a9fe553fd206190b27f | N개 인스턴스 병렬)

-

그래프 분석

NVIDIA Grace CPU 슈퍼칩은 Arm Neoeverse V2 코어를 맞춤형 NVIDIA Scaled Coherency 패브릭과 연결하여 코어 간 통신 및 동기화를 강조하는 GapBS Breadth First Search와 같은 워크로드에서 놀라운 성능을 제공합니다. NVIDIA Grace는 주요 x86 시스템 대비 서버 수준에서 2배 이상의 성능과 3배 향상된 에너지 효율을 제공합니다.

-

데이터 분석

데이터가 계속 증가함에 따라 기업은 경쟁 우위를 확보하기 위해 데이터 학습을 극대화해야 합니다. HiBench 제품군은 지식 발견 및 데이터 마이닝을 위한 K-평균 클러스터링을 테스트하며, NVIDIA Grace CPU의 고대역폭 및 저전력 메모리를 활용합니다. Grace CPU는 현재 시중의 주요 x86 CPU보다 에너지 효율이 2배 이상 높습니다.

-

날씨

기상 예측 모델은 고성능 컴퓨팅(HPC)의 중요한 활용 사례이며, 기후 변화로 인한 기상 패턴 변화를 이해하고 대응하는 데 필수적입니다. Grace CPU에 탑재된 고대역폭 및 전력 효율적인 LPDDR5X 메모리는 약 16W의 전력으로 최대 500GB/s의 대역폭을 제공하여 기존 x86 솔루션 대비 거의 2배 더 많은 작업을 동일한 전력 범위 내에서 수행할 수 있도록 합니다.

-

마이크로서비스

마이크로서비스는 데이터 센터가 수요에 맞춰 쉽게 확장할 수 있도록 하는 소규모 독립 서비스들의 집합입니다. 또한 전체 애플리케이션에 영향을 주지 않고 개별 서비스를 관리할 수 있는 유연성을 제공합니다. Google Protobufs는 마이크로서비스 실행에 필수적인 시스템 간 데이터 교환에 필요한 데이터를 얼마나 빨리 직렬화하고 파싱할 수 있는지 측정합니다. NVIDIA Grace CPU의 고성능 및 전력 효율성은 데이터 센터 처리량을 극대화하는 최고의 성능과 전력 효율성을 제공합니다.

Platform Full stack Provider 리더스시스템즈는

DGX System 기반 AI 데이터센터 통합 솔루션을 제공합니다.

회사소개 바로가기

-

NVIDIA Partner Network 인증 파트너

NVIDIA Elite Partner인 리더스시스템즈는 복잡한 글로벌 공급망 환경 속에서도 확실하고 안정적인 GPU 공급 능력을 보장합니다. 최고 등급 파트너십을 통해 최신 GPU를 가장 빠르고 안정적으로 확보하고, 이를 기반으로 고객의 AI 및 딥러닝 인프라 구축에 중단 없는 안정적인 솔루션을 제공합니다.

-

AI 인프라 구축·운영 토탈 서비스

리더스시스템즈는 AI 인프라 설계 > 구축 > 운영 > 최적화까지 모든 단계를 직접 지원합니다. 고객의 비즈니스 확장 속도에 맞춘 모듈형 확장, 미션 크리티컬 데이터센터 요구 조건을 충족하는 고가용성(HA) & 보안 설계로 장기 운영 신뢰성을 보장합니다.

-

운영 효율을 높이는 전문 기술 지원

리더스시스템즈의 AI 전문가가 구축 이후에도 모니터링, 정기 점검, 운영 교육을 지속적으로 지원하며, 이슈 발생 시 신속한 대응으로 다운타임을 최소화합니다. 또한 자원 활용 효율을 높여 전력 및 유지 비용 절 감과 데이터센터 TCO 최적화를 실현합니다.

-

글로벌 파트너십 기반 Full-Stack 공급

DGX System 도입에 필요한 보안 솔루션, 안정적인 전력 공급을 위한 UPS, 냉각 시스템, 네트워크 및 스토리지까지 각 분야에 맞는 검증된 글로벌 기업들과의 기술 협력을 통해 데이터센터 구축을 위한 통합 솔루션을 제공합니다.

Product Specifications

| NVIDIA Grace CPU C1 | NVIDIA Grace CPU Superchip | |

|---|---|---|

| CPU core count | 72 Arm Neoverse V2 cores with 4×128b SVE2 | 144 Arm Neoverse V2 cores with 4×128b SVE2 |

| L1 cache | 64KB i-cache + 64KB d-cache | 64KB i-cache + 64KB d-cache |

| L2 cache | 1MB per core | 1MB per core |

| L3 cache | 114MB | 228MB |

| Base frequency | all-core SIMD frequency |

3.1GHz | 3.0GHz | 3.1GHz | 3.0GHz |

| LPDDR5X size | 120GB, 240GB, and 480GB memory options |

240GB, 480GB, and 960GB on-module memory options |

| Memory bandwidth | Up to 384 GB/s for 480GB Up to 512 GB/s for 120GB, 240GB |

Up to 768 GB/s for 960GB Up to 1024 GB/s for 240GB, 480GB |

| NVIDIA NVLink-C2C bandwidth | N/A | 900GB/s |

| PCIe links | Up to 4x PCIe Gen5 x16 option to bifurcate | Up to 8x PCIe Gen5 x16 option to bifurcate |

| CPU + memory power | Up to 250W TDP with memory | Up to 500W TDP with memory |

클라우드 및 데이터센터를 위한 리소스

-

자세히 보기

자세히 보기Enterprise AI를 위한 소프트웨어

NVIDIA AI Enterprise는 신뢰할 수 있고 안전하며 확장 가능한 AI 운영을 보장하는 동시에 출시 시간을 가속화하고 인프라 비용을 절감할 수 있습니다.

-

자세히 보기

자세히 보기슈퍼컴퓨팅 인프라를 위한 네트워킹

NVIDIA® BlueField® 네트워킹 플랫폼은 클라우드에서 데이터센터, 엣지에 이르기까지 모든 환경에서 모든 워크로드에 안전하고 가속화된 인프라를 제공합니다.

-

자세히 보기

자세히 보기전문가와 상담하기

리더스시스템즈는 기술 전문가들, 다양한 글로벌 기업과 지속적인 파트너쉽을 체결하여 고객에게 가장 효율적인 고성능 네트워크를 구축할 수 있도록 합니다.