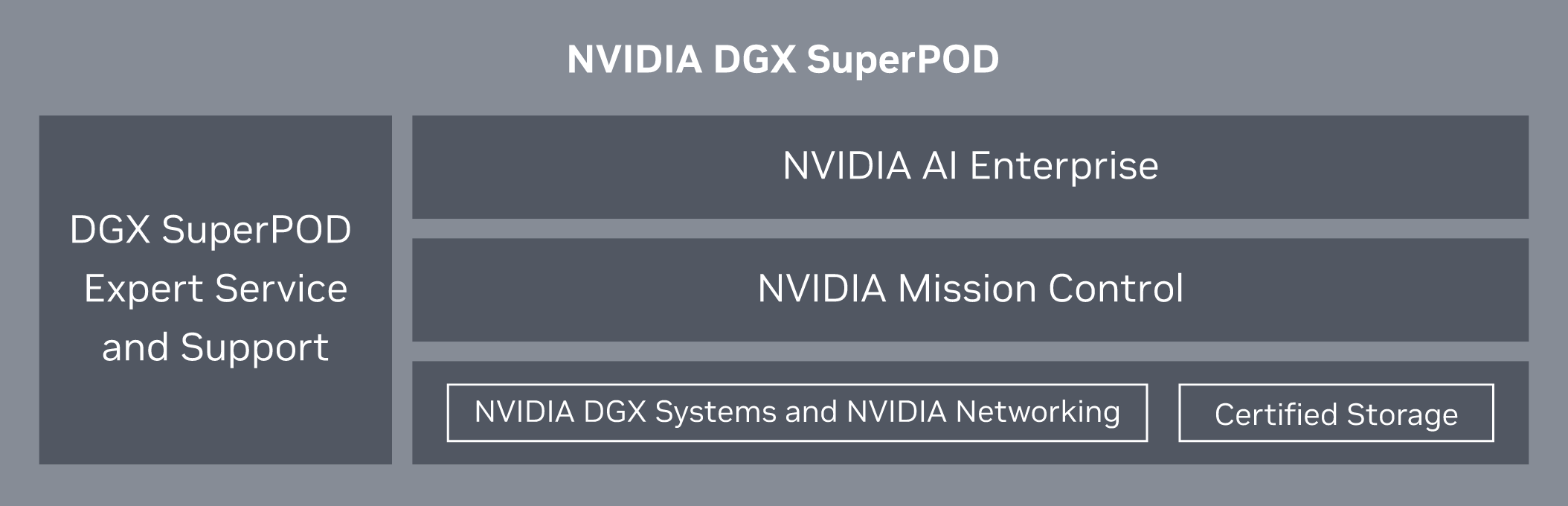

NVIDIA AI Enterprise

모든 조직에서 AI를 사용할 수 있도록 최적화된 엔드 투 엔드 클라우드 기반 AI 및 데이터 분석 소프트웨어 제품군입니다. 엔터프라이즈 데이터센터에서 퍼블릭 클라우드에 이르기까지 어디에서나 배포할 수 있도록 인증받았고, AI 프로젝트를 순조롭게 진행하기 위한 글로벌 엔터프라이즈 지원이 포함됩니다.

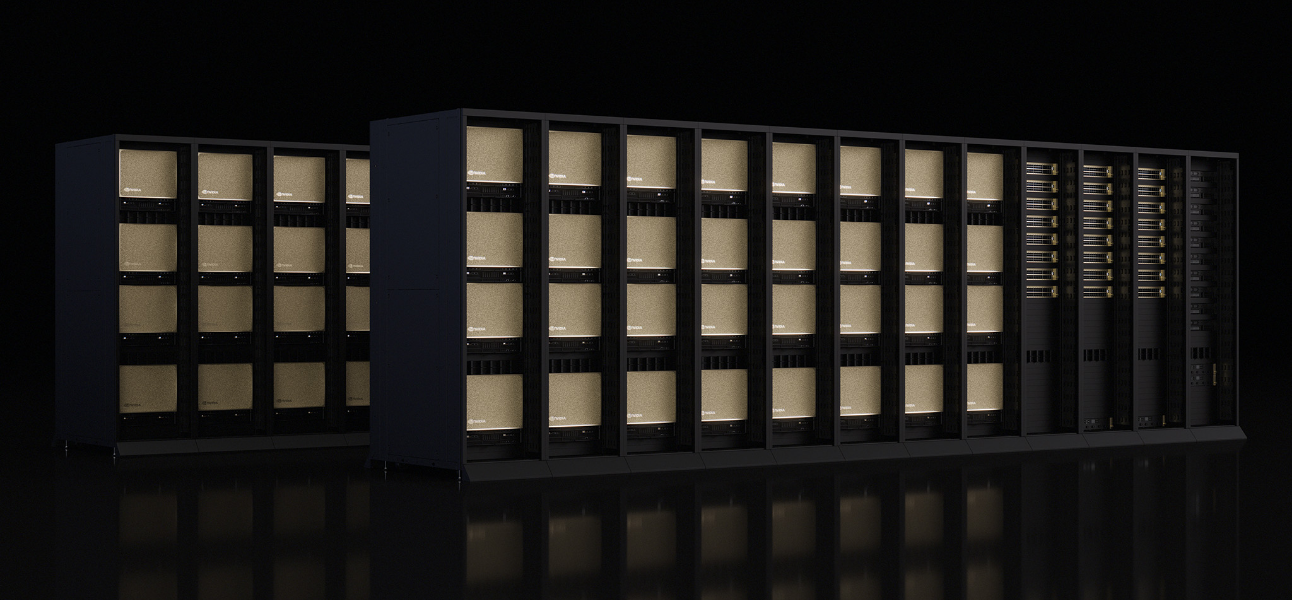

NVIDIA DGX SuperPOD™는 IT가 모든 사용자와 워크로드에 대해 성능 저하 없이 성능을 제공할 수 있도록 지원하는 AI 데이터 센터 인프라입니다. NVIDIA DGX™ 플랫폼 의 일부인 DGX SuperPOD는 업계에서 입증된 결과와 함께 가장 까다로운 AI 워크로드에 대해 최고 수준의 가속화된 인프라와 확장 가능한 성능을 제공합니다.

항상 최고의 NVIDIA AI 혁신을 선보이는 NVIDIA DGX SuperPOD는 NVIDIA DGX 플랫폼의 NVIDIA Blackwell 기반 컴퓨팅 옵션 전체와 함께 제공됩니다. 제품 페이지에서 자세한 사항을 확인하세요.

액체 냉각 방식의 랙 규모 시스템으로, 에이전트형 AI 및 추론 모델의 학습 및 추론 속도를 높이는 동시에 토큰당 비용을 극대화합니다.

대규모 생성 AI와 기타 트랜스포머 기반 워크로드의 훈련과 추론을 위한 NVIDIA Blackwell Ultra 기반 AI 시스템입니다.

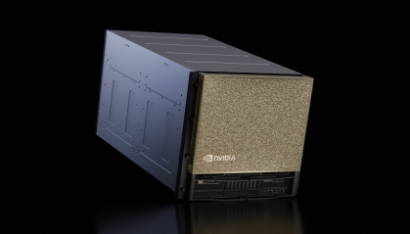

최첨단 기반 모델 학습 및 대규모 추론을 위한 NVIDIA Grace Blackwell Superchips를 탑재한 최고 수준의 액체 냉각 AI 시스템입니다.

NVIDIA Rubin 기반의 범용 AI 시스템은 기업에 에이전트형 AI 모델의 학습 및 추론을 위한 완벽한 AI 플랫폼을 제공합니다.

NVIDIA Blackwell Ultra 프로세서로 구동되는 AI 시스템은 대규모 생성형 AI 및 기타 트랜스포머 기반 워크로드의 학습 및 추론을 지원합니다.

NVIDIA Blackwell을 기반으로 구축된 통합 AI 시스템은 학습부터 미세 조정, 추론에 이르기까지 AI 파이프라인의 모든 단계를 지원합니다.

NVIDIA는 기업이 엔터프라이즈에 가장 중요한 AI 사용 사례를 배포하는 것을 더 쉽고 빠르며 비용 효율적으로 만들었습니다. DGX SuperPOD 레퍼런스 아키텍처의 성능, 확장성 및 관리 용이성을 NVIDIA AI Enterprise 소프트웨어 제품군의 업계 맞춤형 소프트웨어 및 도구와 결합하면 엔터프라이즈는 이러한 입증된 플랫폼에 AI Center of Excellence를 직접 구축할 수 있습니다.

NVIDIA AI 엔터프라이즈 소프트웨어 제품군에는 NVIDIA 최고의 데이터 과학 도구, 사전 훈련된 모델, 최적화된 프레임워크 등이 포함되어 있으며 NVIDIA 엔터프라이즈 지원이 완벽하게 지원됩니다. NVIDIA AI Enterprise는 DGX 플랫폼에 포함되어 있으며 NVIDIA Base Command 와 함께 사용됩니다.

NVIDIA AI Enterprise는 데이터 사이언스 파이프라인을 가속화하고 생성형 AI를 포함한 프로덕션 급 AI 애플리케이션의 개발 및 배포를 간소화하는 엔드 투 엔드 클라우드 네이티브 소프트웨어 플랫폼입니다. AI를 기반으로 비즈니스를 운영하는 기업들은 파일럿에서 프로덕션으로 원활하게 전환할 수 있도록 NVIDIA AI Enterprise가 제공하는 보안, 지원 및 안정성을 신뢰합니다. AI 실무자를 위한 동급 최고의 개발 도구, 프레임 워크, 사전 트레이닝된 모델과 IT 전문가를 위한 신뢰할 수 있는 관리 및 오케스트레이션을 통해 성능, 고가용성, 보안을 보장합니다.

데이터 사이언스와 AI를 발전시키려면 조직은 클라우드 및 데이터센터에서 엣지에 이르는 GPU 기반 시스템을 최적화할 수 있는 도구를 이용해야 합니다.

NVIDIA의 소프트웨어 솔루션은 모든 최신 워크로드를 포괄하므로 IT 관리자, 데이터 사이언티스트, DevOps 팀과 개발자가 필요한 것을 빠르고 쉽게 이용할 수 있습니다.

모든 조직에서 AI를 사용할 수 있도록 최적화된 엔드 투 엔드 클라우드 기반 AI 및 데이터 분석 소프트웨어 제품군입니다. 엔터프라이즈 데이터센터에서 퍼블릭 클라우드에 이르기까지 어디에서나 배포할 수 있도록 인증받았고, AI 프로젝트를 순조롭게 진행하기 위한 글로벌 엔터프라이즈 지원이 포함됩니다.

CUDA-X AI는 딥 러닝, 머신 러닝 및 HPC(고성능 컴퓨팅)를 위한 필수 최적화를 제공하는 NVIDIA의 획기적인 병렬 프로그래밍 모델인 CUDA® 위에 구축된 소프트웨어 가속화 라이브러리 컬렉션입니다. cuDNN, cuML, NVIDIA® TensorRT™, cuDF, cuGraph 및 13개 이상의 기타 라이브러리가 포함됩니다.

NVIDIA Magnum IO™는 병렬의 비동기식 지능형 데이터센터 IO를 위한 아키텍처로, 멀티 GPU, 멀티 노드 가속화를 위해 스토리지 및 네트워크 IO 성능을 극대화합니다. 스토리지 IO, 네트워크 IO, 인-네트워크 컴퓨팅 및 IO 관리를 활용하여 멀티 GPU, 멀티 노드 시스템을 위한 데이터 이동, 액세스 및 관리를 단순화하고 가속화합니다.

어디에서나 더 저렴한 비용으로 사이버 보안 애플리케이션을 구축, 맞춤 설정 및 확장할 수 있도록 지원하는 GPU 가속 엔드 투 엔드 AI 프레임워크입니다. Morpheus 개발 프레임워크는 API로 구현 가능하며, 대용량 데이터를 실시간으로 분석하여 탐지 속도를 높이고, 생성적 AI를 통해 인간 분석가의 역량을 확장하여 최적의 효율성을 제공합니다.

NVIDIA® Riva는 완전히 사용자 정의 가능한 실시간 대화형 AI 파이프라인을 구축하기 위한 GPU 가속 다국어 음성 및 번역 마이크로서비스 세트입니다. Riva에는 자동 음성 인식(ASR), 텍스트 음성 변환(TTS), 신경 기계 번역(NMT)이 포함되며 모든 장치에 배포할 수 있습니다. LLM(대형 언어 모델) 및 RAG(검색 증강 생성)를 활용하세요.

엣지, 데이터 센터, 멀티 및 하이브리드 클라우드 환경에서 이기종 AI 및 고성능 컴퓨팅(HPC) 클러스터에 대한 빠른 배포와 엔드투엔드 관리를 제공합니다. 몇 개의 노드에서 수십만 개의 노드에 이르는 클러스터의 프로비저닝 및 관리를 자동화하고, NVIDIA GPU 가속 및 기타 시스템을 지원하며, Kubernetes와의 오케스트레이션을 활성화합니다.

NVIDIA NGC™는 엔터프라이즈 서비스, 소프트웨어, 관리 도구, 엔드 투 엔드 AI 및 디지털 트윈 워크플로우 지원을 위한 포털입니다. 완전 관리형 서비스를 통해 솔루션을 더 빠르게 출시하거나, 성능 최적화된 소프트웨어를 활용하여 선호하는 클라우드, 온프레미스, 엣지 시스템에서 솔루션을 구축하고 배포할 수 있습니다.

NVIDIA Mission Control은 세계적 수준의 전문 지식을 소프트웨어로 제공하여 워크로드부터 인프라까지 AI 팩토리 운영을 간소화합니다. NVIDIA Grace Blackwell 데이터센터를 구동하여 추론 및 학습에 즉각적인 민첩성을 제공하는 동시에 인프라 복원력을 위한 풀스택 인텔리전스를 제공합니다. 모든 기업은 하이퍼스케일 효율성으로 AI를 실행하여 AI 실험을 간소화하고 가속화할 수 있습니다.

자세히 보기

University of Florida의 대학은 NVIDIA DGX SuperPOD인 HiPerGator AI를 활용하여 AI 우수 센터를 설립하여 임상 결과 개선부터 재난 구호 강화까지 다양한 분야의 연구를 추진했습니다.

KT는 NVIDIA DGX SuperPOD에서 NVIDIA NeMo™ 프레임워크를 사용하여 언어 복잡성을 마스터하고 스마트 스피커 및 컨택 센터에 대한 교육을 2배 더 빠르게 달성하는 동시에 2,200만 명 이상의 가입자를 지원합니다.

DeepL은 DGX SuperPOD인 DeepL Mercury 슈퍼컴퓨터를 사용하여 자체 LLM을 구축하고 가장 혁신적인 언어 AI 기술로 기업과 개인에게 역량을 부여합니다.

즉시 실행할 수 있는 턴키 방식의 AI 개발 플랫폼을 찾고 계신가요?

NVIDIA DGX가 탑재된 Equinix Private AI는 Equinix colocation data centers, 네트워크 연결 및

관리형 서비스를 활용하여 DGX BasePOD 및 DGX SuperPOD™를 호스팅하고 운영합니다.

NVIDIA DGX를 탑재한 Equinix Private AI는 데이터 센터 및 관리형 서비스에 대한 Equinix의 전문 지식을 활용하여 코로케이션, 연결 및 포괄적인 관리를 통해 네트워크, 보안, 데이터, 애플리케이션 및 하이브리드 클라우드 문제를 해결합니다.

선도적인 스토리지 기술 제공업체와 협력하여 NVIDIA DGX SuperPOD에서 참조 아키텍처 솔루션 포트폴리오를 사용할 수 있습니다. NVIDIA 파트너 네트워크를 통해 완벽하게 통합되고 즉시 배포 가능한 제품으로 제공되는 이러한 솔루션은 데이터 센터 AI 인프라를 더 간단하고 빠르게 설계, 배포 및 관리할 수 있도록 해줍니다.

NVIDIA 엔터프라이즈 서비스는 DGX 인프라에 대한 지원, 교육 및 전문 서비스를 제공합니다. AI 여정의 모든 단계에서 NVIDIA 전문가를 이용할 수 있는 엔터프라이즈 서비스는 프로젝트를 빠르고 성공적으로 시작하고 실행하는 데 도움을 줄 수 있습니다.

모든 NVIDIA DGX™ 플랫폼에는 DGX 인프라, NVIDIA AI Enterprise 및 NVIDIA Base Command™ 소프트웨어에 대한 엔터프라이즈 지원이 포함되어 있으며 여기에는 강화된 시스템 소프트웨어, 최적화된 AI 라이브러리, 세계적 수준의 클러스터 관리, 강력한 작업 예약 및 워크로드 조정이 포함됩니다. NVIDIA DGX 배포를 최대한 활용하고 NVIDIA 전문성과 입증된 방법론을 통해 AI 실험을 간소화하세요.

DGX 플랫폼 사용을 시작하는 가장 빠른 방법은 생성 AI를 개발하는 기업을 위해 특별히 제작된 서버리스 서비스형 AI 훈련 플랫폼인 NVIDIA DGX Cloud를 사용하는 것입니다.

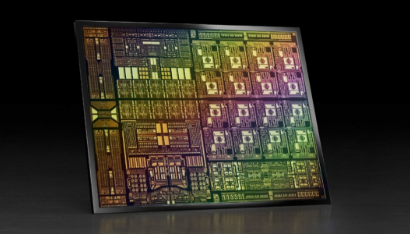

GPU, DPU 및 CPU용 3개의 차세대 아키텍처를 기반으로 구축된 NVIDIA 가속 컴퓨팅 플랫폼으로 AI 시대의 데이터센터를 재구성하세요.

이러한 아키텍처는 성능, 보안, 네트워킹 등을 포괄하는 최첨단 기술을 통해 최신 데이터센터의 모든 문제를 처리할 준비가 되어 있습니다.

리더스시스템즈는 NVIDIA Elite Partner로서 Blackwell 및 Grace 기반 시스템 도입 경험을 바탕으로 소프트웨어 스택(NVIDIA AI Enterprise)과 시스템 튜닝을 고객의 워크로드에 맞춰 최적화합니다.

설계부터 구축, 운영, 최적화까지 모든 단계를 직접 지원합니다. 고객의 비즈니스 확장 속도에 맞춘 모듈형 확장과 고가용성(HA) 설계로 장기 운영 신뢰성을 보장합니다.

구축 이후에도 모니터링, 정기 점검, 운영 교육을 지속적으로 지원하며, 이슈 발생 시 신속한 대응으로 다운타임을 최소화하고 데이터센터 TCO 최적화를 실현합니다.

시스템 도입에 필요한 보안, 전력(UPS), 냉각 시스템, 네트워크 및 스토리지까지 검증된 글로벌 기업들과의 기술 협력을 통해 통합 솔루션을 제공합니다.

NVIDIA AI Enterprise는 신뢰할 수 있고 안전하며 확장 가능한 AI 운영을 보장하는 동시에 출시 시간을 가속화하고 인프라 비용을 절감할 수 있습니다.

NVIDIA® BlueField® 네트워킹 플랫폼은 클라우드에서 데이터센터, 엣지에 이르기까지 모든 환경에서 모든 워크로드에 안전하고 가속화된 인프라를 제공합니다.

리더스시스템즈는 기술 전문가들, 다양한 글로벌 기업과 지속적인 파트너쉽을 체결하여 고객에게 가장 효율적인 고성능 네트워크를 구축할 수 있도록 합니다.