전 세계 데이터 센터에 전력을 공급하기 위한 400Gb/s 인프라 컴퓨팅 플랫폼

AI 팩토리는 전례 없는 규모로 계속 성장하며 정형 데이터, 비정형 데이터, 그리고 새롭게 등장하는 AI 기반 데이터를 처리하고 있습니다. 수조 개의 토큰을 처리하는 워크로드에 대한 수요가 폭발적으로 증가함에 따라, 이를 따라잡기 위해서는 새로운 유형의 인프라가 필요합니다. NVIDIA BlueField-4는 AI 데이터 스토리지, 네트워킹 및 보안 전반에 걸친 소프트웨어 정의 가속 기능을 통해 데이터 센터를 안전하고 지능적인 AI 인프라로 전환합니다. 모든 AI 환경에서 모든 워크로드를 가속화하도록 설계된 이 제품은 새로운 차원의 AI 스토리지 플랫폼을 위한 엔드투엔드 엔진으로, AI 데이터 파이프라인의 기반에 AI 데이터 스토리지 가속 기능을 제공하여 효율적인 데이터 처리와 획기적인 대규모 성능을 구현합니다.

NVIDIA BlueField를 통한

AI 데이터센터 혁신

NVIDIA® BlueField® 플랫폼은 AI를 위한 새로운 형태의 목적 기반 데이터센터, AI 팩토리에 전례 없는 성능, 효율성, 그리고 혁신을 제공합니다. 네트워킹, 스토리지, 보안을 위한 강력한 컴퓨팅 성능과 통합된 소프트웨어 정의 하드웨어 가속기를 통해 BlueField는 모든 환경과 워크로드에서 안전하고 효율적인 인프라를 구축하며, 가속 컴퓨팅과 AI의 새로운 시대를 주도합니다.

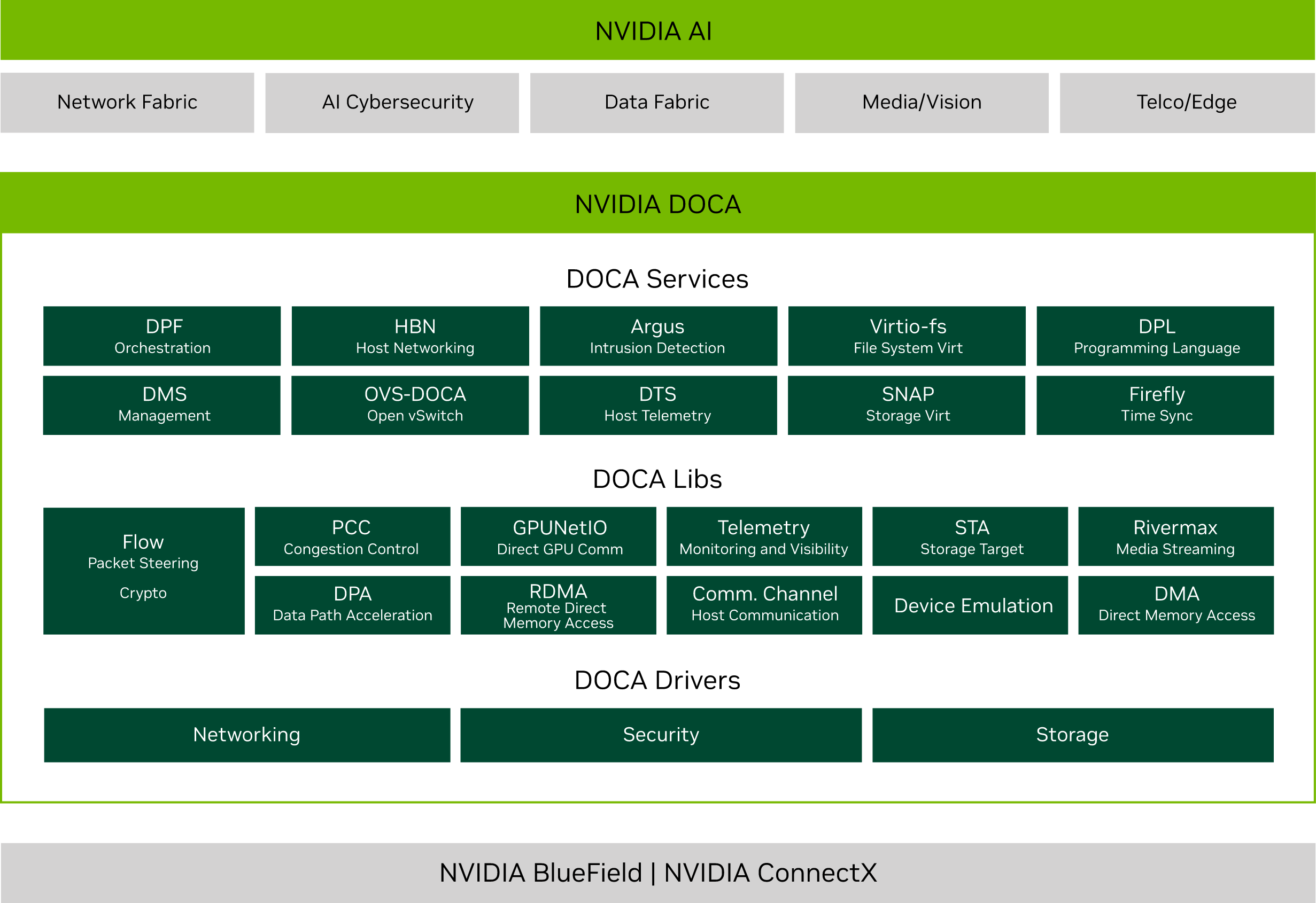

NVIDIA DOCA 마이크로서비스

NVIDIA Doca™는 NVIDIA® Bluefield® 네트워킹 플랫폼의 잠재력을 극대화합니다. Bluefield Dpu와 Supernic의 강력한 성능을 활용하여 Doca는 데이터 센터 워크로드를 오프로드, 가속 및 격리하는 애플리케이션과 서비스를 신속하게 개발할 수 있도록 지원합니다.

개발자는 Doca를 통해 소프트웨어 정의 방식의 클라우드 네이티브 DPU 및 Supernic 가속 서비스를 제로 트러스트 보호 기능과 함께 구축하여 최신 데이터 센터의 성능 및 보안 요구 사항을 충족할 수 있습니다. DOCA-Host에는 NVIDIA Bluefield 및 Connectx® 장치에 필요한 모든 호스트 드라이버와 도구가 포함되어 있습니다.

메시지 전달 인터페이스(MPI) 성능 가속화

현대 과학 컴퓨팅을 위한 애플리케이션 성능과 시스템 효율성을 극대화하세요. 강력한 컴퓨팅, 고속 NVIDIA Quantum InfiniBand 네트워킹 및 고도로 프로그래밍 가능한 엔진을 제공하는 NVIDIA BlueField® 네트워킹 플랫폼은 현대 과학 컴퓨팅 애플리케이션에 전례 없는 혁신과 성능을 촉발합니다. HPC 및 AI 통신 프레임워크와 라이브러리는 대기 시간과 대역폭에 민감하며 애플리케이션 성능을 결정하는 데 중요한 역할을 합니다.

NVIDIA DOCA™는 다중 프로세스 통신을 가속화하는 MPI 및 공유 메모리 라이브러리(SHMEM)를 비롯한 다양한 서비스를 제공합니다. DOCA를 사용하면 BlueField DPU가 애플리케이션의 통신 기간을 계산 기간과 병행하여 진행할 수 있어 애플리케이션 성능이 향상됩니다.

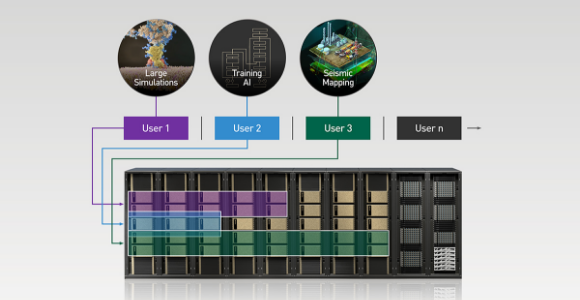

적응형 성능 분리

최신 데이터 센터 와 다중 애플리케이션 환경은 절대적인 최고 효율성으로 운영되어야 합니다. Bluefield 네트워킹 플랫폼은 적응형 성능 격리를 지원하여 네트워크 원격 측정 정보와 애플리케이션 성능 특성을 활용하여 애플리케이션의 베어메탈 성능을 보장합니다. 이를 통해 애플리케이션을 동시에 실행하고 단일 애플리케이션 실행과 유사한 성능을 얻을 수 있습니다.

고성능, 확장성, 보안을 갖춘

기가 스케일 AI 데이터센터를 위한 차세대 네트워킹

AI 데이터센터는 검색 증강 생성(RAG), 모델 훈련, 추론을 위해 가속화된 네트워크 성능을 필요로 합니다. NVIDIA 네트워킹은 오늘날의 AI 사용 사례에 필요한 최고 수준의 효율성과 최저 레이턴시의 데이터 전송을 보장합니다.

AI 및 클라우드를 위한 가속 Ethernet

클라우드 컴퓨팅, 데이터 스토리지, AI 등을 포함한 다양한 애플리케이션에서 업계 최고의 이더넷 성능, 가용성 및 사용 편의성을 경험해 보세요. NVIDIA Spectrum™ 이더넷은 Spectrum 스위치, NVIDIA® ConnectX® NIC, BlueField® DPU 및 SuperNIC, LinkX® 케이블, 네트워킹 소프트웨어 등을 포함하는 End-To-End 플랫폼입니다.

AI 및 과학 컴퓨팅을 위한 InfiniBand

복잡한 워크로드에는 고해상도 시뮬레이션, 매우 큰 크기의 데이터세트 및 고도로 병렬화된 알고리즘의 초고속 처리가 필요합니다. 이러한 요구 사항이 계속 늘어나는 추세에서, 세계 유일의 완전 오프로드 가능한 인-네트워크 컴퓨팅 플랫폼인 NVIDIA Quantum InfiniBand는 성능을 극적으로 향상해 비용과 복잡성이 적으면서도 더 빠른 발견 시간을 달성합니다.

최신 AI를 위한 가속 네트워킹을 위한 엔터프라이즈 및 데이터센터 소프트웨어

NVIDIA® 소프트웨어 제품은 서버, 애플리케이션 및 패브릭 요소 간의 격차를 해소하는 혁신적인 애플리케이션 중심 접근 방식을 제공합니다. 이러한 제품은 독립적으로 또는 시너지 효과를 발휘하여 모니터링을 개선하고, 지연 시간을 줄이며, CPU 사이클을 오프로드하여 애플리케이션 성능을 향상시키고 생산성을 높이며 비즈니스 성과를 개선할 수 있습니다.

-

UFM (Unified Fabric Manager)

NVIDIA UFM® 플랫폼은 연구 및 산업 데이터 센터 운영자가 최신 데이터 센터 패브릭을 효율적으로 프로비저닝, 모니터링, 관리 및 사전 예방적으로 문제를 해결할 수 있도록 지원합니다.

-

NVIDIA® HPC -X®

NVIDIA HPC -X는 메시지 전달 인터페이스(MPI), 대칭 계층형 메모리(SHMEM) 및 분할된 전역 주소 공간(PGAS) 통신 라이브러리와 다양한 가속 패키지를 포함하는 포괄적인 소프트웨어 패키지입니다.

-

BlueField DPU Software

BlueField DPU에서 효율적인 맞춤 설정, 구현 및 검증을 위해 일반적인 오픈 소스 도구를 사용하여 빠르고 쉽게 개발할 수 있도록 지원합니다.

-

InfiniBand Drivers

NVIDIA UFM® 플랫폼은 연구 및 산업 데이터 센터 운영자가 최신 데이터 센터 패브릭을 효율적으로 프로비저닝, 모니터링, 관리 및 사전 예방적으로 문제를 해결할 수 있도록 지원합니다. (참고: 이미지상에서 UFM의 설명이 InfiniBand Drivers 섹션에 중복 기재되어 있는 것으로 보입니다.)

-

Ethernet Drivers

NVIDIA® 이더넷 드라이버, 프로토콜 소프트웨어 및 도구는 주요 운영체제(OS) 벤더 및 배포판에서 기본 제공(Inbox) 방식으로 지원되거나, 명시된 경우 NVIDIA에서 직접 지원합니다. NVIDIA는 모든 주요 프로세서 아키텍처를 지원합니다.

-

BlueField SNAP™

NVMe SNAP는 가상화된 스토리지를 베어 메탈 클라우드에 제공하며 스토리지 분할을 지원해 구성 가능한 스토리지를 단순하게 만들어줍니다.

NVIDIA Magnum IO™

기업들은 데이터를 정제하고 지능형 제조업체로 거듭나고 있습니다. 데이터 센터는 가속 컴퓨팅 기술 덕분에 AI 공장으로 변모하고 있으며, 이 기술은 컴퓨팅 속도를 백만 배 향상시켰습니다. 하지만 가속 컴퓨팅에는 가속 I/O가 필수적입니다.

NVIDIA Magnum IO는 병렬 지능형 데이터 센터 I/O를 위한 아키텍처입니다. 대규모 언어 모델, 추천 시스템, 이미지 처리, 시뮬레이션, 과학 연구 등 세계에서 가장 중요한 애플리케이션을 위해 스토리지, 네트워크, 멀티 노드, 멀티 GPU 통신을 극대화합니다.

가상화, 컨테이너화 및 베어메탈 환경에서 CPU, GPUsns, DPU 및 스토리지 하위 시스템 간의 데이터 이동의 모든 측면을 다룹니다.

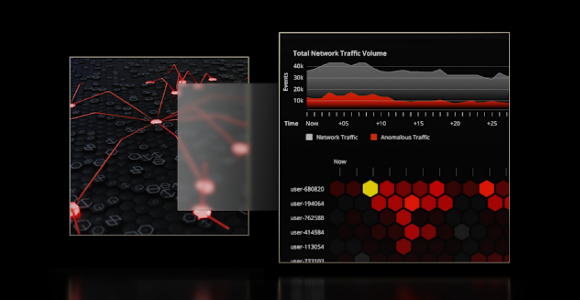

NVIDIA Morpheus

NVIDIA Morpheus 는 GPU 가속 기반의 엔드투엔드 AI 프레임워크로, 개발자가 대용량 스트리밍 사이버 보안 데이터를 필터링, 처리 및 분류하는 데 최적화된 애플리케이션을 구축할 수 있도록 지원합니다. Morpheus는 AI를 활용하여 위협 식별, 포착 및 대응에 소요되는 시간과 비용을 절감하고 데이터 센터, 클라우드 및 엣지 환경에 새로운 차원의 보안을 제공합니다. 또한, Morpheus는 생성형 AI를 통해 실시간 분석 및 대응을 자동화하고, 위험을 정확하게 식별하는 AI 모델을 학습하기 위한 합성 데이터를 생성하며, 다양한 시나리오를 실행함으로써 인간 분석가의 역량을 확장합니다.

지원되는 DPU 기술 환경

-

NVIDIA 클라우드 네이티브

슈퍼컴퓨팅 구축 및 배포베어메탈 속도로 공유 컴퓨팅 리소스에 대한 성능 격리를 제공하는 동시에 안전한 멀티테넌트 환경을 제공하는 방법을 알아보세요. 비디오 튜토리얼부터 단계별 배포 가이드까지 NVIDIA는 NVIDIA 클라우드 네이티브 슈퍼컴퓨팅 여정을 시작하는 데 필요한 모든 자료를 제공합니다.

-

제로 트러스트

아키텍처 제공BlueField 네트워킹 플랫폼은 새로운 테넌트에 대한 사전 잔여 없이 슈퍼컴퓨팅 리소스가 안전하게 프로비저닝되도록 보장합니다. BlueField는 새로 예약된 테넌트에 대한 클린 부팅 이미지를 제공하고, 전체 리소스 정리를 수행하고, 할당된 인프라 리소스에 대한 신뢰를 다시 설정합니다.

-

고성능, 효율적인

네트워킹BlueField는 기존 애플리케이션과 최신 GPU 가속 워크로드 모두에 대해 최대 400Gb/s 연결을 제공하는 동시에 호스트 CPU 코어를 확보하여 인프라 작업 대신 애플리케이션을 실행하는 강력한 데이터 센터 서비스 가속기입니다.

-

소프트웨어

정의 인프라NVIDIA DOCA 소프트웨어 개발 키트를 사용하면 개발자는 업계 표준 API를 활용하는 고성능, 소프트웨어 정의, 클라우드 네이티브, DPU 가속 서비스를 쉽게 만들 수 있습니다.

AI와 데이터 분석에서 고성능 컴퓨팅(HPC)과 렌더링까지, NVIDIA 통합 플랫폼

GPU, DPU 및 CPU용 3개의 차세대 아키텍처를 기반으로 구축된 NVIDIA 가속 컴퓨팅 플랫폼으로 AI 시대의 데이터센터를 재구성하세요.

이러한 아키텍처는 성능, 보안, 네트워킹 등을 포괄하는 최첨단 기술을 통해 최신 데이터센터의 모든 문제를 처리할 준비가 되어 있습니다.

Platform Full stack Provider 리더스시스템즈는

DGX System 기반 AI 데이터센터 통합 솔루션을 제공합니다.

회사소개 바로가기

-

NVIDIA Partner Network 인증 파트너

리더스시스템즈는 NVIDIA Elite Partner로서 Blackwell 및 Grace 기반 시스템 도입 경험을 바탕으로 소프트웨어 스택(NVIDIA AI Enterprise)과 시스템 튜닝을 고객의 워크로드에 맞춰 최적화합니다.

-

AI 인프라 구축·운영 토탈 서비스

설계부터 구축, 운영, 최적화까지 모든 단계를 직접 지원합니다. 고객의 비즈니스 확장 속도에 맞춘 모듈형 확장과 고가용성(HA) 설계로 장기 운영 신뢰성을 보장합니다.

-

운영 효율을 높이는 전문 기술 지원

구축 이후에도 모니터링, 정기 점검, 운영 교육을 지속적으로 지원하며, 이슈 발생 시 신속한 대응으로 다운타임을 최소화하고 데이터센터 TCO 최적화를 실현합니다.

-

글로벌 파트너십 기반 Full-Stack 공급

시스템 도입에 필요한 보안, 전력(UPS), 냉각 시스템, 네트워크 및 스토리지까지 검증된 글로벌 기업들과의 기술 협력을 통해 통합 솔루션을 제공합니다.

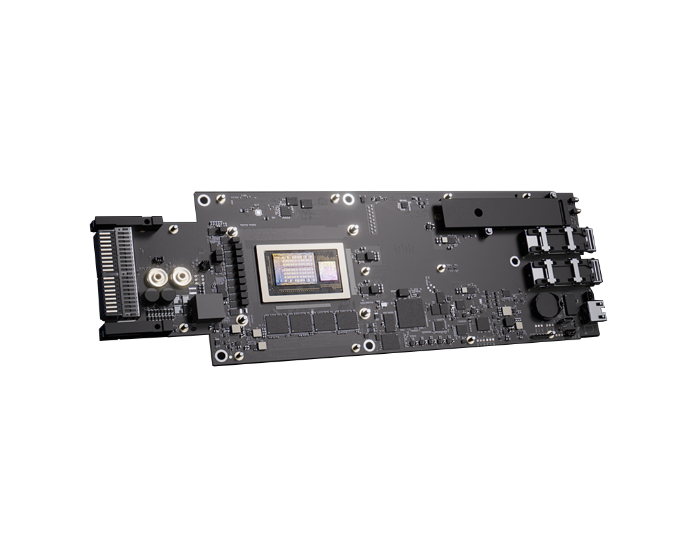

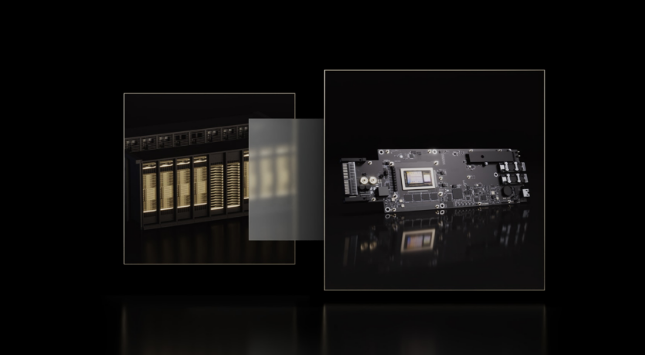

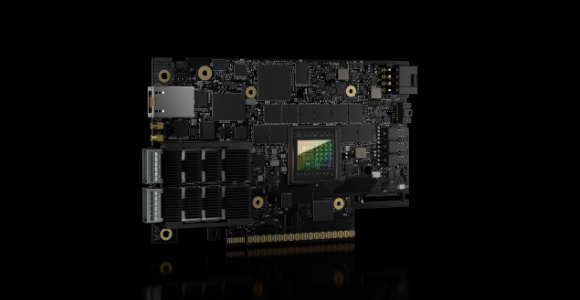

NVIDIA® BlueField®-4 데이터 처리 장치(DPU)

NVIDIA® BlueField®-4 데이터 처리 장치(DPU)는 기가스케일(gigascale) AI 팩토리를 위해 특수 설계된 가속 인프라 플랫폼으로, 최대 **800Gb/s(초당 기가비트)**의 처리량을 제공합니다. 고성능 컴퓨팅을 위한 NVIDIA Grace™ CPU와 NVIDIA® ConnectX®-9 네트워킹의 결합을 통해, BlueField-4는 새로운 차원의 가속, 효율성 및 사이버 보안을 실현하며 AI 데이터 센터 인프라의 모든 계층에 강력한 동력을 공급합니다.

이 플랫폼은 강력한 데이터 처리 기능, 기본 서비스 체이닝(service function chaining), 내장 보안 가속 및 압도적인 I/O 성능을 통합합니다. 또한 고성능 스토리지 컨트롤러 역할을 수행하여 가속화되고 안전한 소프트웨어 정의(software-defined) 데이터 액세스를 가능하게 합니다. 이를 통해 서비스 제공업체와 기업은 보안 스토리지, 신속한 데이터 액세스, 고성능 추론을 지원함과 동시에 대규모의 멀티 테넌트 AI 인프라 및 데이터 플랫폼을 구축하고 워크로드 효율을 극대화할 수 있습니다.

Key Features

| Network Interfaces |

|

|---|---|

| PCIe interface |

|

| Compute and Memory |

|

| Storage |

|

| Cybersecurity |

|

| AI Networking |

|

| Cloud Networking |

|

| Management and Control |

|

| Network Boot |

|

- * This section describes hardware features and capabilities. For feature availability, refer to the NVIDIA DOCA release notes.